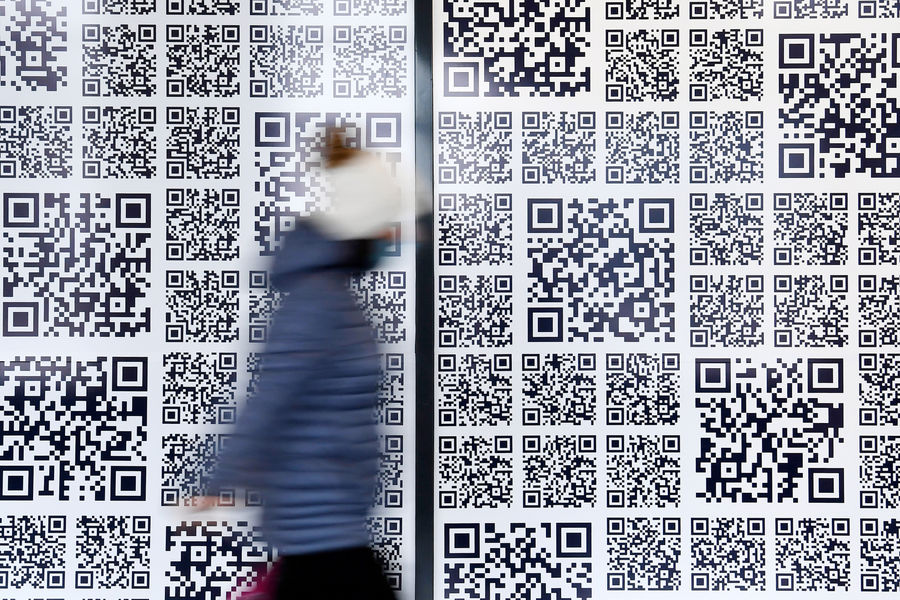

С начала 2024 года в рунете был замечен всплеск фишинговых атак при помощи QR-кодов на россиян в соцсетях и мессенджерах. Об этом «Газете.Ru» рассказал начальник отдела информационной безопасности «Кода Безопасности» Алексей Коробченко.

Сейчас QR-коды используются сразу в нескольких схемах мошеннических атак. Одна из самых распространенных – перенаправление на вредоносный сайт. Злоумышленники рассылают жертвам материалы рекламного характера с QR-кодом, по которой жертва переходит на фишинговый ресурс. Если ввести персональные данные на таком сайте, то хакеры получат доступ к конфиденциальной информации пользователя, в частности к управлению его аккаунтами.

«Еще один типичный вектор фишинговой атаки – вредоносный файл из вложения или по ссылке. Такие файлы имитируют важные документы от регуляторов, срочные обновления или установочные файлы, например, для подключения к встрече по видеоконференцсвязи. В нашем случае злоумышленники прячут эти важные документы в QR-код, чтобы обойти средства почтовой защиты», – объяснил эксперт.

Кроме того, по словам Коробченко, мошенники активно используют растущую популярность проведения платежей через QR-коды – для этого они заменяют данные в коде, например, реквизиты пользователя на собственные, чтобы получить деньги на свой счет.

По словам эксперта, для кражи аккаунтов в мессенджерах злоумышленники чаще всего прибегают к социальной инженерии, чтобы вынудить пользователей просканировать вредоносный QR-код через Telegram, WhatsApp или Discord. Эти сервисы используют такие коды для аутентификации сеансов, поэтому если пользователь просканирует вредоносный QR, мошенники смогут получить доступ к его аккаунтам, персональным данным и перепискам.

Ранее россиянам рассказали, какие девайсы подслушивают их разговоры.

Читать дальше новости технологий на нашем сайте